Kunsmatige algemene intelligensie: Verskil tussen weergawes

Sobaka (besprekings | bydraes) →Eienskappe: orden |

Sobaka (besprekings | bydraes) →Eienskappe: bywerk |

||

| Lyn 43: | Lyn 43: | ||

Dit sluit die vermoë in om gevaar op te spoor en daarop te reageer.<ref>{{cite journal | last1 = White | first1 = R. W. | year = 1959 | title = Motivation reconsidered: The concept of competence | journal = Psychological Review | volume = 66 | issue = 5| pages = 297–333 | doi=10.1037/h0040934| pmid = 13844397 }}</ref> |

Dit sluit die vermoë in om gevaar op te spoor en daarop te reageer.<ref>{{cite journal | last1 = White | first1 = R. W. | year = 1959 | title = Motivation reconsidered: The concept of competence | journal = Psychological Review | volume = 66 | issue = 5| pages = 297–333 | doi=10.1037/h0040934| pmid = 13844397 }}</ref> |

||

=== Wiskundige formules === |

|||

'n Wiskundig presiese spesifikasie van KAI is voorgestel deur Marcus Hutter in 2000. Genoem AIXI, die voorgestelde KAI-agent maksimeer "die vermoë om doelwitte in 'n wye verskeidenheid omgewings te bevredig".<ref>{{cite book |last=Hutter |first=Marcus |date=2005 |title=Universal Artificial Intelligence: Sequential Decisions Based on Algorithmic Probability |series=Texts in Theoretical Computer Science an EATCS Series |url=https://link.springer.com/book/10.1007/b138233 |publisher=Springer |doi=10.1007/b138233 |isbn=978-3-540-26877-2 |access-date=19 Julie 2022 |archive-date=19 Julie 2022 |archive-url=https://web.archive.org/web/20220719052038/https://link.springer.com/book/10.1007/b138233 |url-status=live }}</ref> Hierdie tipe KAI, wat gekenmerk word deur die vermoë om 'n wiskundige definisie van intelligensie te maksimeer eerder as om mensagtige gedrag te vertoon,<ref>{{cite thesis |last=Legg |first=Shane |date=2008 |title=Machine Super Intelligence |publisher=University of Lugano |url=http://www.vetta.org/documents/Machine_Super_Intelligence.pdf |access-date=19 July 2022 |archive-date=15 Junie 2022 |archive-url=https://web.archive.org/web/20220615160113/https://www.vetta.org/documents/Machine_Super_Intelligence.pdf |url-status=live }}</ref> word ook universele kunsmatige intelligensie genoem.<ref>{{cite journal|journal=Journal of Artificial General Intelligence|last=Goertzel|first=Ben|title=Artificial General Intelligence: Concept, State of the Art, and Future Prospects|series=Lecture Notes in Computer Science |date=2014|volume=8598 |doi=10.1007/978-3-319-09274-4 |isbn=978-3-319-09273-7 |s2cid=8387410 |url=https://www.researchgate.net/publication/271390398}}</ref> |

|||

In 2015 het Jan Lieke en Marcus Hutter gewys dat Legg-Hutter-intelligensie - "'n agent se vermoë om doelwitte in 'n wye reeks omgewings te bereik"<ref>{{Cite web |last1=Everitt |first1=Tom |last2=Lea |first2=Gary |last3=Hutter |first3=Marcus |title=AGI Safety Literature Review |url=https://www.ijcai.org/proceedings/2018/0768.pdf |access-date=26 April 2023 |website=International Joint Conferences on Artificial Intelligence Organization}}</ref> - gemeet word met betrekking tot "'n vaste Universal Turing Machine (UTM). AIXI is die mees intelligente beleid as dit dieselfde UTM gebruik, 'n resultaat wat "alle bestaande optimaliteitseienskappe vir AIXI ondermyn".<ref>{{cite conference | conference=The 28th Conference on Learning Theory | last1=Leike | first1=Jan | last2=Hutter | first2=Marcus | title=Bad Universal Priors and Notions of Optimality | date=2015 | eprint=1510.04931 | url=https://proceedings.mlr.press/v40/Leike15.html | access-date=6 Desember 2022 | archive-date=6 Desember 2022 | archive-url=https://web.archive.org/web/20221206020503/https://proceedings.mlr.press/v40/Leike15.html | url-status=live }}</ref> Hierdie probleem spruit uit AIXI se gebruik van kompressie as 'n proxy vir intelligensie, wat slegs geldig is indien kognisie in isolasie plaasvind van die omgewing waarin doelwitte nagestreef word. Dit formaliseer 'n filosofiese posisie bekend as gees-liggaam dualisme. <ref name=”mtb1”>{{cite arXiv |last=Bennett |first=Michael Timothy |date=2022 |title=Computable artificial general intelligence |class=cs.AI |eprint=2205.10513}}</ref> Sommige vind enaktivisme meer aanneemlik - die idee dat kognisie plaasvind binne dieselfde omgewing waarin doelwitte nagestreef word.<ref>{{cite journal |last1=Ward |first1=Dave |last2=Silverman |first2=David |last3=Villalobos |first3=Mario |date=2017 |title=Introduction: The Varieties of Enactivism |journal=Topoi |volume=36 |issue=1 |pages=365–375 |doi=10.1007/s11245-017-9484-6 |s2cid=247434831 |doi-access=free }}</ref> Daarna het Michael Timothy Bennett enaktiewe kognisie geformaliseer en 'n alternatiewe proxy vir intelligensie genaamd "swakheid" geïdentifiseer.<ref name=”mtb1” /> Die meegaande eksperimente (wat swakheid en kompressie vergelyk) en wiskundige bewyse het getoon dat die maksimalisering van swakheid die optimale "vermoë om 'n wye reeks take te voltooi"<ref name=”mtb2” /> of ekwivalent "vermoë om te veralgemeen"<ref>{{cite arXiv |last=Chollet |first=Francois |date=2019 |title=On the Measure of Intelligence |class=cs.AI |eprint=1911.01547}}</ref> tot gevolg het (dus maksimeer intelligensie volgens enige definisie ). As enaktivisme geld en gees-liggaam dualisme nie, dan is kompressie nie nodig of voldoende vir intelligensie nie, wat wydverspreide sienings oor intelligensie bevraagteken (sien ook Hutter-prys). |

|||

== Verwysings == |

== Verwysings == |

||

Wysiging soos op 09:49, 18 Junie 2023

'n Kunsmatige algemene intelligensie (KAI) is 'n tipe hipotetiese intelligente agent. Die KAI-konsep is dat dit kan leer om enige intellektuele taak wat mense of ander diere kan verrig, uit te voer.[1][2] Alternatiewelik is KAI gedefinieer as 'n outonome stelsel wat menslike vermoëns in die meeste ekonomies waardevolle take oortref.[3] Die skep van KAI is 'n primêre doelwit van sommige kunsmatige intelligensie-navorsing en maatskappye soos OpenAI,[3] DeepMind,[4] en Anthropic. KAI is 'n algemene onderwerp in wetenskapfiksie en toekomsstudies.

Die tydlyn vir KAI-ontwikkeling bly 'n onderwerp van voortdurende debat onder navorsers en kundiges. Sommige argumenteer dat dit moontlik oor jare of dekades kan wees, ander hou vol dat dit 'n eeu of langer kan neem, en 'n minderheid glo dat dit dalk nooit bereik sal word nie.[5] Daarbenewens is daar debat oor die vraag of moderne diepleerstelsels, soos GPT-4, 'n vroeë dog onvolledige vorm van KAI[6] is of as nuwe benaderings vereis word.[7]

Daar bestaan twis oor die potensiaal vir KAI om 'n bedreiging vir die mensdom in te hou; byvoorbeeld, OpenAI hanteer dit as 'n eksistensiële risiko, terwyl ander vind dat die ontwikkeling van KAI te ver is om 'n risiko in te hou.[8][5][7]

'n 2020-opname het 72 aktiewe KAI navorsingsprojekte geïdentifiseer wat oor 37 lande versprei is.[9]

Terminologie

KAI staan ook bekend as sterk KI,[10][11][12] volle KI,[13] of algemene intelligente aksie.[14][15] Sommige akademiese bronne behou egter die term "sterk KI" vir rekenaarprogramme wat gevoel of bewussyn ervaar.[16][17] Daarteenoor is swak KI (of nou KI) in staat om een spesifieke probleem op te los, maar het nie algemene kognitiewe vermoëns nie.[18][11] Sommige akademiese bronne gebruik "swak KI" om wyer te verwys na enige programme wat nie bewussyn ervaar of ook nie 'n verstand in dieselfde sin as mense het nie.[19]

Verwante konsepte sluit in menslike vlak KI, transformerende KI,[5] en superintelligensie.

Eienskappe

Hoofartikel: Kunsmatige intelligensie

Verskeie kriteria vir intelligensie is voorgestel (die mees bekende Turingtoets) maar geen definisie word algemeen aanvaar nie. John McCarthy skryf: " ons kan nog nie in die algemeen karakteriseer watter soort berekeningsprosedures ons intelligent wil noem nie."[21][22]

Intelligensie eienskappe

Navorsers meen egter oor die algemeen dat intelligensie nodig is om die volgende te doen: [23]

- redeneering, gebruikmaking van strategie, los raaisels op en beoordeel onder onsekerheid;

- verteenwoordig kennis, insluitend gesonde verstandkennis;

- beplan;

- leer;

- kommunikeer in natuurlike taal;

en, indien nodig, integreer hierdie vaardighede in die voltooiing van enige gegewe doelwit.

Baie interdissiplinêre benaderings (bv. kognitiewe wetenskap, rekenaarintelligensie en besluitneming) oorweeg bykomende eienskappe soos verbeelding (die vermoë om nuwe geestelike beelde en konsepte te vorm)[24] en outonomie.[25]

Rekenaargebaseerde stelsels wat baie van hierdie vermoëns vertoon, bestaan (sien byvoorbeeld rekenaarkreatiwiteit, outomatiese redenasie, besluitondersteuningstelsel, robot, evolusionêre berekening, intelligente agent). Daar is egter geen konsensus dat moderne KI-stelsels dit in 'n voldoende mate besit nie.

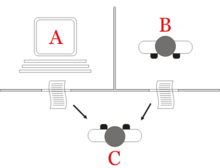

Fisiese eienskappe

Ander belangrike vermoëns sluit in:[26]

- die vermoë om aan te voel (bv. sien, hoor, ens.), en

- die vermoë om op te tree (bv. beweeg en manipuleer voorwerpe, verander ligging om te verken, ens.)

Dit sluit die vermoë in om gevaar op te spoor en daarop te reageer.[27]

Wiskundige formules

'n Wiskundig presiese spesifikasie van KAI is voorgestel deur Marcus Hutter in 2000. Genoem AIXI, die voorgestelde KAI-agent maksimeer "die vermoë om doelwitte in 'n wye verskeidenheid omgewings te bevredig".[28] Hierdie tipe KAI, wat gekenmerk word deur die vermoë om 'n wiskundige definisie van intelligensie te maksimeer eerder as om mensagtige gedrag te vertoon,[29] word ook universele kunsmatige intelligensie genoem.[30]

In 2015 het Jan Lieke en Marcus Hutter gewys dat Legg-Hutter-intelligensie - "'n agent se vermoë om doelwitte in 'n wye reeks omgewings te bereik"[31] - gemeet word met betrekking tot "'n vaste Universal Turing Machine (UTM). AIXI is die mees intelligente beleid as dit dieselfde UTM gebruik, 'n resultaat wat "alle bestaande optimaliteitseienskappe vir AIXI ondermyn".[32] Hierdie probleem spruit uit AIXI se gebruik van kompressie as 'n proxy vir intelligensie, wat slegs geldig is indien kognisie in isolasie plaasvind van die omgewing waarin doelwitte nagestreef word. Dit formaliseer 'n filosofiese posisie bekend as gees-liggaam dualisme. [33] Sommige vind enaktivisme meer aanneemlik - die idee dat kognisie plaasvind binne dieselfde omgewing waarin doelwitte nagestreef word.[34] Daarna het Michael Timothy Bennett enaktiewe kognisie geformaliseer en 'n alternatiewe proxy vir intelligensie genaamd "swakheid" geïdentifiseer.[33] Die meegaande eksperimente (wat swakheid en kompressie vergelyk) en wiskundige bewyse het getoon dat die maksimalisering van swakheid die optimale "vermoë om 'n wye reeks take te voltooi"[35] of ekwivalent "vermoë om te veralgemeen"[36] tot gevolg het (dus maksimeer intelligensie volgens enige definisie ). As enaktivisme geld en gees-liggaam dualisme nie, dan is kompressie nie nodig of voldoende vir intelligensie nie, wat wydverspreide sienings oor intelligensie bevraagteken (sien ook Hutter-prys).

Verwysings

- ↑ Hodson, Hal (1 Maart 2019). "DeepMind and Google: the battle to control artificial intelligence". 1843 magazine. Geargiveer vanaf die oorspronklike op 7 Julie 2020. Besoek op 7 Julie 2020.

AGI stands for Artificial General Intelligence, a hypothetical computer program...

- ↑ Shevlin, Henry; Vold, Karina; Crosby, Matthew; Halina, Marta (4 Oktober 2019). "The limits of machine intelligence: Despite progress in machine intelligence, artificial general intelligence is still a major challenge". EMBO Reports (in Engels). 20 (10): e49177. doi:10.15252/embr.201949177. ISSN 1469-221X. PMC 6776890. PMID 31531926.

- ↑ 3,0 3,1 "OpenAI Charter". openai.com (in Engels (VSA)). Besoek op 6 April 2023.

- ↑ "About". openai.com (in Engels (VSA)). Besoek op 6 April 2023.

- ↑ 5,0 5,1 5,2 "AI timelines: What do experts in artificial intelligence expect for the future?". Our World in Data. Besoek op 6 April 2023.

- ↑ Bubeck, Sébastien; Chandrasekaran, Varun; Eldan, Ronen; Gehrke, Johannes; Horvitz, Eric; Kamar, Ece; Lee, Peter; Lee, Yin Tat et al. (2023-03-27). "Sparks of Artificial General Intelligence: Early experiments with GPT-4". [cs.CL].

- ↑ 7,0 7,1 "Artificial general intelligence: Are we close, and does it even make sense to try?". MIT Technology Review (in Engels). Besoek op 6 April 2023.

- ↑ "Impressed by artificial intelligence? Experts say AGI is coming next, and it has 'existential' risks". ABC News (in Australian English). 23 Maart 2023. Besoek op 6 April 2023.

- ↑ Baum, Seth, A Survey of Artificial General Intelligence Projects for Ethics, Risk, and Policy, Global Catastrophic Risk Institute Working Paper 20, https://gcrinstitute.org/papers/055_agi-2020.pdf, besoek op 13 Januarie 2022

- ↑ Kurzweil 2005, p. 260.

- ↑ 11,0 11,1 Kurzweil, Ray (5 Augustus 2005), "Long Live AI", Forbes, archived from the original on 2005-08-14, https://web.archive.org/web/20050814000557/https://www.forbes.com/home/free_forbes/2005/0815/030.html: Kurzweil describes strong AI as "machine intelligence with the full range of human intelligence."

- ↑ Treder, Mike (10 Augustus 2005), "Advanced Human Intelligence", Responsible Nanotechnology, https://crnano.typepad.com/crnblog/2005/08/advanced_human_.html

- ↑ "The Age of Artificial Intelligence: George John at TEDxLondonBusinessSchool 2013". Geargiveer vanaf die oorspronklike op 26 Februarie 2014. Besoek op 22 Februarie 2014.

- ↑ Newell & Simon 1976

- ↑ Dit is die term wat hulle gebruik vir "menslike-vlak" intelligensie in die fisiese simboolstelsel hipotese.

- ↑ "Searle's Strong AI"

- ↑ Sien hieronder vir die oorsprong van die term "sterk KI", en sien die akademiese definisie van "sterk KI" en swak KI in die artikel Chinese kamer.

- ↑ "The Open University on Strong and Weak AI". Geargiveer vanaf die oorspronklike op 25 September 2009. Besoek op 8 Oktober 2007.

- ↑ "Searle's Strong AI"

- ↑ Beeld aangepas vanaf Saygin 2000

- ↑ McCarthy, John (2007a). "Basic Questions". Stanford University. Geargiveer vanaf die oorspronklike op 26 Oktober 2007. Besoek op 6 Desember 2007.

- ↑ Vir 'n bespreking van sommige definisies van intelligensie wat deur kunsmatige intelligensie navorsers gebruik word, sien filosofie van kunsmatige intelligensie.

- ↑ Hierdie lys van intelligente eienskappe is gebaseer op die onderwerpe wat deur groot KI-handboeke gedek word, insluitend: Russell & Norvig 2003, Luger & Stubblefield 2004, Poole, Mackworth & Goebel 1998 and Nilsson 1998.

- ↑ Johnson 1987

- ↑ de Charms, R. (1968). Personal causation. New York: Academic Press.

- ↑ Pfeifer, R. and Bongard J. C., How the body shapes the way we think: a new view of intelligence (The MIT Press, 2007). ISBN 0-262-16239-3

- ↑ White, R. W. (1959). "Motivation reconsidered: The concept of competence". Psychological Review. 66 (5): 297–333. doi:10.1037/h0040934. PMID 13844397.

- ↑ Hutter, Marcus (2005). Universal Artificial Intelligence: Sequential Decisions Based on Algorithmic Probability. Texts in Theoretical Computer Science an EATCS Series. Springer. doi:10.1007/b138233. ISBN 978-3-540-26877-2. Geargiveer vanaf die oorspronklike op 19 Julie 2022. Besoek op 19 Julie 2022.

- ↑ Sjabloon:Cite thesis

- ↑ Goertzel, Ben (2014). "Artificial General Intelligence: Concept, State of the Art, and Future Prospects". Journal of Artificial General Intelligence. Lecture Notes in Computer Science. 8598. doi:10.1007/978-3-319-09274-4. ISBN 978-3-319-09273-7. S2CID 8387410.

- ↑ Everitt, Tom; Lea, Gary; Hutter, Marcus. "AGI Safety Literature Review" (PDF). International Joint Conferences on Artificial Intelligence Organization. Besoek op 26 April 2023.

- ↑ (2015) "Bad Universal Priors and Notions of Optimality" in The 28th Conference on Learning Theory..

- ↑ 33,0 33,1 Bennett, Michael Timothy (2022). "Computable artificial general intelligence". [cs.AI].

- ↑ Ward, Dave; Silverman, David; Villalobos, Mario (2017). "Introduction: The Varieties of Enactivism". Topoi. 36 (1): 365–375. doi:10.1007/s11245-017-9484-6. S2CID 247434831.

- ↑ Verwysingfout: Invalid

<ref>tag; no text was provided for refs named”mtb2” - ↑ Chollet, Francois (2019). "On the Measure of Intelligence". [cs.AI].